type

date

slug

status

summary

tags

category

password

icon

📄「8x7B」是首个开源的 MoE 大模型,共有 560 亿个参数,支持 32k 上下文窗口。支持英语、法语、德语、西班牙语和意大利语,但是实测输入中文也会回答

📈在 7 个基准测试中,「8x7B」超过了 Llama2 70B,并且达到或超过 GPT-3.5

🤖️Mistral AI 被外界称作欧洲版 OpenAI ,并且「8x7B」使用了与 GPT-4 非常相似但规模较小的架构,所以未来非常有机会与 OpenAI 分庭抗礼

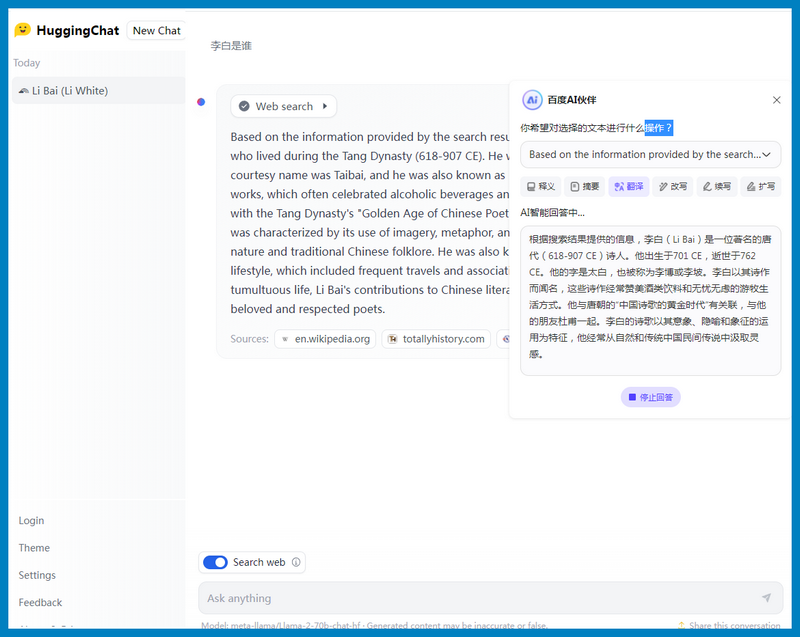

在线体验(需要切换到8x7b模型)

- Author:205066

- URL:https://www.205066.xyz/article/8x7b

- Copyright:All articles in this blog, except for special statements, adopt BY-NC-SA agreement. Please indicate the source!